Dos estudios recientes han avanzado significativamente en el desarrollo de sistemas que permiten a vehículos y robots autónomos «ver» y reaccionar de manera más humana. Publicados en la revista científica Nature, estos estudios presentan un nuevo procesador y un algoritmo que mejoran la precisión y reducen el tiempo de respuesta de la visión mecánica, elementos cruciales para la conducción autónoma y la robótica avanzada.

El Instituto de Microelectrónica de Sevilla, en colaboración con el Consejo Superior de Investigaciones Científicas (CSIC) y la Universidad de Sevilla, ha desarrollado estas innovaciones que ya están siendo utilizadas por empresas multinacionales como Samsung y Sony. Los sistemas se basan en el principio de foveación, que imita cómo los humanos enfocan su visión en un punto de interés, permitiendo una alta resolución en áreas críticas mientras se reduce en las áreas periféricas no relevantes.

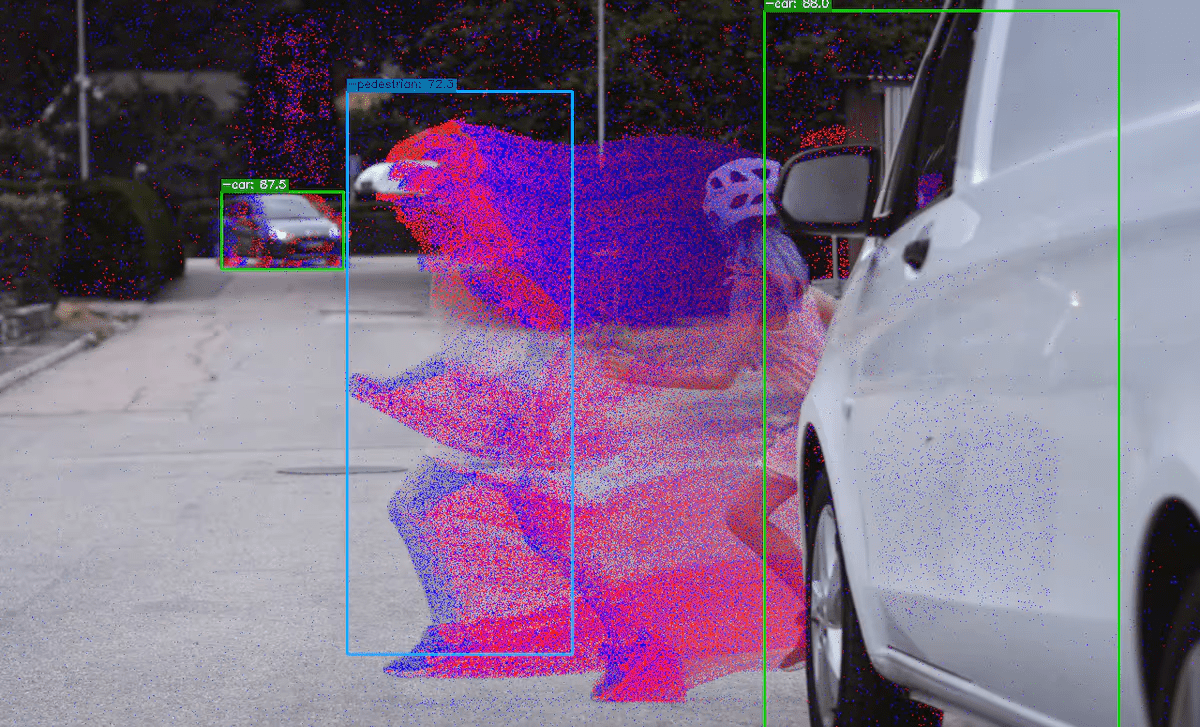

El primer avance, creado por Daniel Gehrig de la Universidad de Pensilvania y Davide Scaramuzza de la Universidad de Zúrich, se centra en la toma de decisiones a partir de imágenes de alta resolución a color. Aunque estas imágenes requieren un gran ancho de banda y más tiempo para ser procesadas, el estudio propone el uso de cámaras de eventos que manejan flujos continuos de datos, logrando así reducir la latencia aunque con una menor precisión.

Estos desarrollos son fundamentales para que los vehículos autónomos y robots puedan interpretar escenas con rapidez y precisión, discriminando entre objetos estáticos y dinámicos, como un árbol y un peatón, respectivamente. Esto permitirá reacciones inmediatas y decisiones más seguras en milisegundos, acercando la tecnología a una visión y comportamiento más humano en situaciones complejas de la vida real.